TU Wien:Einführung in Visual Computing VU (W. Kropatsch, W. Purgathofer, R. Sablatnig)/Test 2 2012S

CG Teil[Bearbeiten | Quelltext bearbeiten]

1. Clipping & Antialiasing[Bearbeiten | Quelltext bearbeiten]

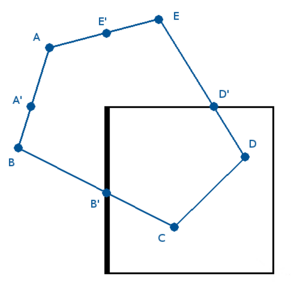

Beispiel - Polygonclipping

Nebenstehendes Polygon ABCDE soll an der linken Fensterkante (dicke Linie) mit dem Sutherland-Hodgmen-Verfahren geclippt werden (beginnend mit Kante AB, dann BC, usw.)

Geben Sie in der untenstehenden Tabelle für jeden Schritt den korrekten Fall (in->in, in->out,...) sowie die ausgegebenen Vertices an. (Hinweis: Nicht jeder Zwischenvertex X' muss verwendet werden. Nicht alle Ergebniszeilen werden benötigt.)

| Schritt | Fall | Vertex Output |

|---|---|---|

| 1. | -> | |

| 2. | -> | |

| 3. | -> | |

| 4. | -> | |

| 5. | -> | |

| 6. | -> | |

| 7. | -> | |

| 8. | -> | |

| 9. | -> | |

| 10. | -> |

Kreuzen Sie die richtigen Behauptungen an!

- Für das Antialiasing von Linien wird oft die Farbintensität eines Pixels proportional zum Überdeckungsgrad der Pixelfläche durch eine Linie gewählt.

- Aliasing entsteht durch eine zu geringe Abtastung eines Signals.

- Supersampling ist eine geeignete Methode, um Aliasing eines gegebenen Rasterbildes nachträglich zu verringern.

- Damit ein Signal korrekt rekonstruiert werden kann, muss es mindestens mit der höchsten Informationsfrequenz abgetastet werden (Nyquist-Limit)

2. Ray-Casting[Bearbeiten | Quelltext bearbeiten]

Kreuzen Sie die richtigen Behauptungen an!

- Ein Nachteil von Ray-Casting ist der hohe Speicherbedarf, der durch die vielen Rays (mehrere Millionen!) entsteht.

- Mittels Backface-Culling können alle nicht sichtbaren Polygone einer Szene entfernt werden (meistens etwa 50%)

- Beim Ray-Casting wird durch jedes Pixel ein Strahl in Blickrichtung in die Szene gelegt und mit allen Objekten geschnitten.

- Mittels Backface-Culling können im Schnitt etwa die Hälfte aller Polygone einer Szene als unsichtbar identifiziert werden.

- Beim Backface-Culling wird ein Polygon entfernt, wenn sein Oberflächenvektor vom Betrachter weg zeigt.

- Der Z-Puffer speichert für jedes Pixel stets die Tiefe des am fernsten liegenden Polygons, das diesen Pixel überdeckt.

- Beim Z-Buffering wird im Framebuffer ein Pixel eines Polygons nur gezeichnet, wenn sein Z-Wert näher zum Betrachter liegt als der im Puffer gespeicherte Wert.

3. Beleuchtung[Bearbeiten | Quelltext bearbeiten]

Kreuzen Sie die richtigen Behauptungen an!

- Bei diffuser Beleuchtung ist die beobachtete Helligkeit abhängig vom Blickwinkel auf die Oberfläche.

- Laut Lambert'schen Gesetz ist eine Oberfläche dort am hellsten, wo das Licht orthogonal auf die Oberfläche auftrifft.

- Bei der Gourard-Schattierung wird die tatsächliche Beleuchtungsberechnung nur für die Eckpunkte des Polygons durchgeführt.

- Je kleiner der Cosinus-Exponent im Phong-Beleuchtungsmodell, desto rauher wirkt die Oberfläche.

- Die Phong-Schattierung erlaubt es, für jedes Polygonpixel individuell die Beleuchtung zu berechnen.

- Der Nachteil der Phongschattierung ist das etwaige Auftreten des Mach-Band-Effekts.

- Wie muss der Phong-Exponent gewählt werden, damit die Oberfläche theoretisch einem Spiegel gleicht?

- 0

- 1

- -1

- unendlich

Außerdem:

- Beleuchtungsberechnung mit Omni-Lichtquelle (Lambert'sches Gesetz anwenden)

4. Radiosity[Bearbeiten | Quelltext bearbeiten]

- Frage zu Radiosity - Patches (Verständnisfrage nach dem Reziprokitätsprinzip)

- Ankreuzen von richtigen Behauptungen

5. Texture- und Environmentmapping[Bearbeiten | Quelltext bearbeiten]

Ankreuzen von richtigen Behauptungen.

CV Teil[Bearbeiten | Quelltext bearbeiten]

Demosaicing[Bearbeiten | Quelltext bearbeiten]

3x3 ausschnitt; aufnahme mit CCD-bildsensor; color filter array (bayer filter) verwendet:

GB ...

RG

.

.

berechnen sie den RGB-Farbwert an position *:

200 | 150 | 190 | 130 | 170

110 | 90 | 140 | 100 | 130

210 | 120*| 200 | 140 | 200

140 | 100 | 170 | 120 | 140

220 | 120 | 210 | 110 | 180

linsengleichung[Bearbeiten | Quelltext bearbeiten]

8m vor einer kamera mit der brennweite f=40mm steht jemand. wie weit muss der sensor hinter der linse sein, damit das bild scharf wird?

wahr/falsch[Bearbeiten | Quelltext bearbeiten]

MPEG benoetigt mehr rechenzeit zum codieren als zum decodieren

Jpeg's speicherplatz ist abhaengig von bildinhalt

verktorgrafiken zoomen verlustlos

lauflaengenkodierung halbiert den speicherbedarf maximal

SIFT berechnet (ja/nein)[Bearbeiten | Quelltext bearbeiten]

skalierung

histogram des DoG scale space

hauptorientierung der keypoints

8-bin histogramm der gradientenorientierung 16 zellen um keypoints

grauwerthistogram der lokalen nachbarschaft der keypoints

farbhistogram der lokalen nachbarschaft der keypoints

bestimmung[Bearbeiten | Quelltext bearbeiten]

wieviele bildpunktpaare sind notwending fuer die eindeutinge bestimmung einer translation (1-6)

wieviele bildpunktpaare sind notwending fuer die eindeutinge bestimmung einer affinen translation (1-6)

wahr/falsch[Bearbeiten | Quelltext bearbeiten]

verschiedene Lichtspektren koennen den gleichen Fabreindruck erzeugen

HSV schwarz ist wenn S=0

RGB kann alle menschlich wahrnehmbaren farben darstellen

Magenta ist welche farbe[Bearbeiten | Quelltext bearbeiten]

[ ] R=100 G=000 B=100

[ ] R=255 G=100 B=100

[ ] R=000 G=030 B=030

motion detection[Bearbeiten | Quelltext bearbeiten]

Frame difference

[ ] langsamere bewegung fuehrt dazu, dass mehr bildbereiche als bewegung erkannt werden

[ ] schnellere bewegung fuehrt dazu, dass mehr bildbereiche als bewegung erkannt werden

[ ] geschwindigkeit hat keinen einfluss

differenz zu einem konstanten hintergrundbild:

[ ] langsamere bewegung fuehrt dazu, dass mehr bildbereiche als bewegung erkannt werden

[ ] schnellere bewegung fuehrt dazu, dass mehr bildbereiche als bewegung erkannt werden

[ ] geschwindigkeit hat keinen einfluss

mosaics (wahr/falsch)[Bearbeiten | Quelltext bearbeiten]

blending wird verwendet um registrierungsfehler auszubessern

zur bildregistrierung beim IM koennen SIFT features verwendet werden

wenn kamera nur rotiert wird, reicht translation um bild zusammenzusetzen